OpenAI desenvolve detector de Deepfakes em resposta ao aumento do realismo em conteúdos gerados por IA

Por Sandro Felix

Publicado em 07/05/24 às 17:54

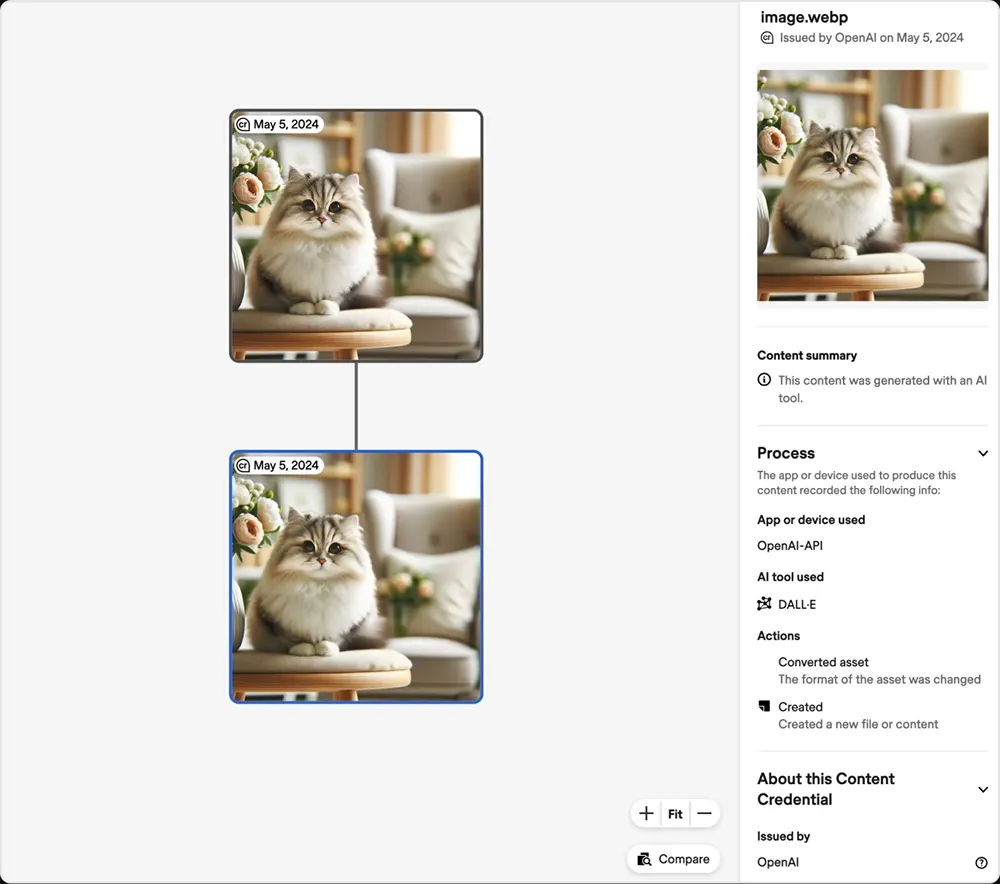

A OpenAI anunciou nesta terça-feira (7) o lançamento de uma nova ferramenta de detecção de imagens, capaz de identificar se uma imagem foi gerada por sua ferramenta de geração de imagens DALL-E 3 ou criada sem a assistência de IA. Este movimento vem em resposta aos crescentes riscos associados ao conteúdo gerado por IA, incluindo a criação de imagens e vídeos com possíveis intenções maliciosas.

Em um post no seu blog oficial, a OpenAI revelou que sua ferramenta pode identificar corretamente imagens geradas por IA em aproximadamente 98% dos casos e retornou falsos positivos — identificando uma imagem real como criada por IA — em apenas 0,5% das situações. A ferramenta será disponibilizada inicialmente para um número limitado de testadores que estão utilizando sua plataforma, permitindo a integração do recurso de detecção de imagens em seus aplicativos.

A necessidade dessa ferramenta se torna ainda mais evidente com o reconhecimento da OpenAI de que, apesar de integrar metadados nas imagens e vídeos criados com suas ferramentas DALL-E 3 e Sora, atores mal-intencionados com um pouco de conhecimento técnico podem remover esses metadados.

Os deepfakes, ou conteúdos sinteticamente gerados projetados para enganar os usuários fazendo-os acreditar que foram gerados por humanos, têm se tornado um problema crescente na internet. Com um número cada vez maior de pessoas recorrendo à IA para criar vídeos, imagens e gravações de áudio falsos, verifica-se que é extremamente importante verificar a veracidade do conteúdo.

Embora a nova ferramenta da OpenAI seja um passo na direção certa, ela não é uma solução definitiva. Ela funciona bem, mas foi treinada apenas em imagens geradas pelo DALL-E 3. Isso significa que, se os atores maliciosos usarem outros geradores de imagens de IA, não há garantia de que a ferramenta da OpenAI funcionará tão bem, se é que funcionará.

Vale ressaltar que, embora a OpenAI tenha elogiado o desempenho de seu sensor de imagens, os vídeos deepfake projetados para enganar os usuários podem ser muito mais difíceis de identificar.

Por fim, mas não menos importante, a OpenAI também anunciou que se juntou ao comitê diretor da Coalizão para Proveniência e Autenticidade de Conteúdo (C2Pa), um padrão amplamente utilizado que certifica conteúdo digital. A empresa não especificou exatamente como impactará o C2Pa, mas disse que “espera contribuir para o desenvolvimento do padrão, considerando-o um aspecto importante de nossa abordagem”.